進捗

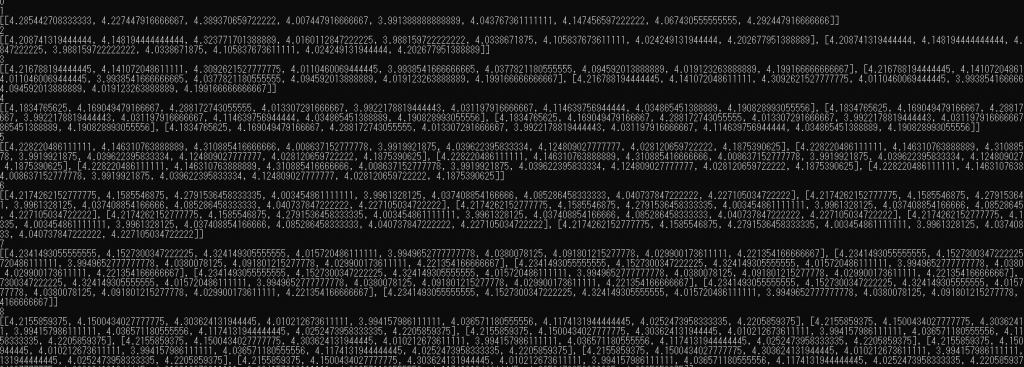

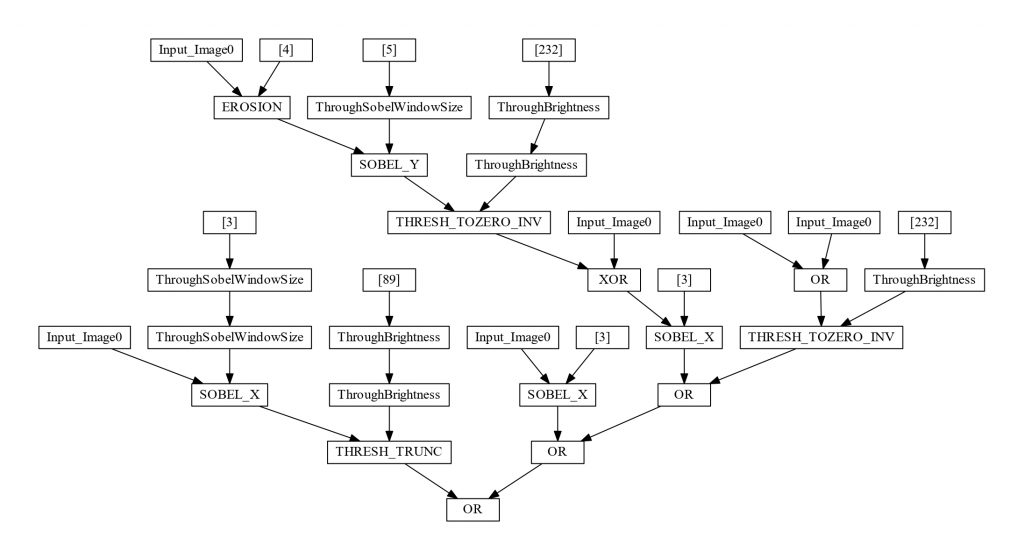

当初予定していたアルゴリズム(GP-GAの入れ子構造。GPで処理フロー最適化、GAでパラメータ最適化)から変更した。これまではGPの中でもLoosely Typed GP (LTGP) と呼ばれる伝統的なGPを用いてきたが、本研究ではStrongly Typed GP(STGP)を採用することでGP単体での処理フロー・パラメータ最適化を実現した。STGPによって作成した木構造を以下に示す (評価値は以前LTGPで作成したフィルタと同程度) 。

修論作成中

STGPで生成した前処理フィルタ

予定

今週の進捗

今週(11月25日〜12月1日)、揚州大学-九工大の樱花计划の実施と関連するレセプション業務に参加しました。

7日間の樱花计划、レセプションの仕事の一部を担当することに加えて、彼は張研究室での講義と研究会議で揚州大学の教師とクラスメートとの研究と交流を行いました。

図 1 揚州大学と張研との交流-1

図 2 揚州大学と張研との交流-2

私の研究活動に関しては、今週はあまり進歩していませんが、報告書を作成して揚州大学とコミュニケーションをとることにより、研究を整理し、後の研究についてより明確に理解しました、自分を応援する。

図 3 コミュニケーション作業の一部-1

今週の進捗

1.歩行者の再識別(ReID)-Deep learning person re-identification in PyTorch、重要なテストフェーズで、問題が発生しました----ValueError: Buffer dtype mismatch, expected 'long' but got 'long long'。

windownsシステムとLinuxオペレーティングシステムのデータ型定義方法が異なるため、長い間見つける理由は解決していません。また、多くのソースプログラムはLinuxオペレーティングシステムに基づいているため、Ubuntu 16.04LTSシステムは張先生と彼のクラスメートの助けを借りてインストールされます。この時点で、トレーニングからやり直します。

図1 Ubuntuシステム

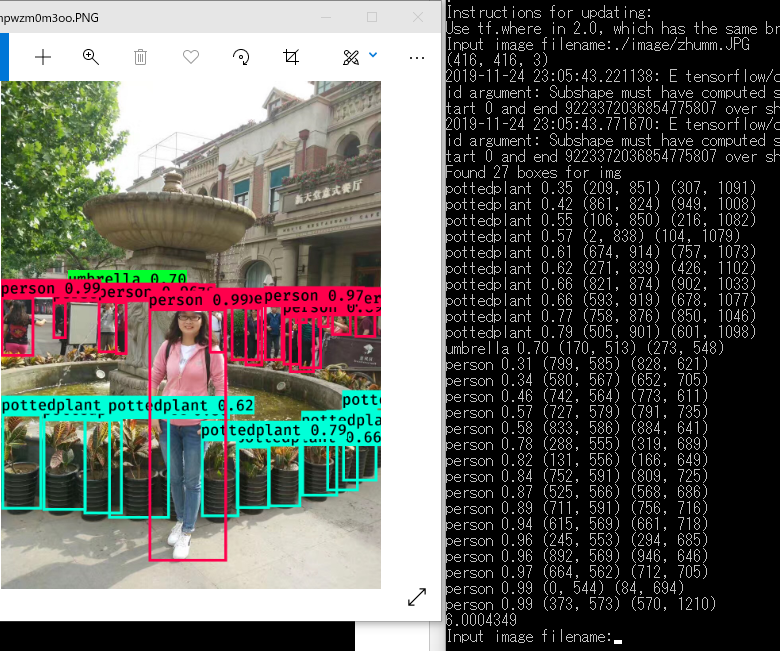

2.先週、画像とビデオのリアルタイム顔検出が実装されました。先週のカメラのリアルタイムビデオキャプチャの前提の下で、ビデオで最初に実装された画像(単一およびバッチ)およびマルチターゲット検出。これに基づいて、歩行者検出のみが実装されます。

全員出席

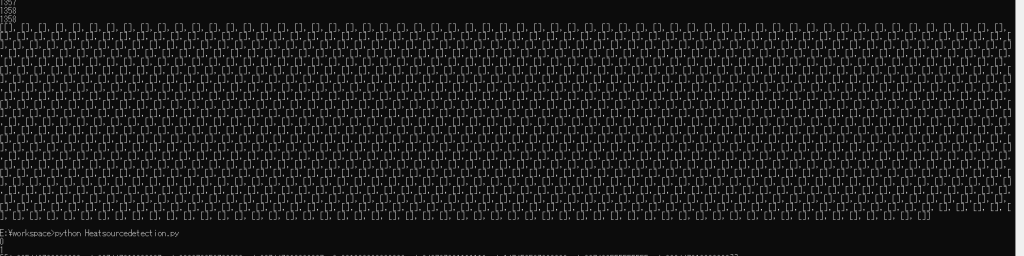

井上:カメラによる熱源検出実験措置を作成し、ビデオ画像を習得した。基礎アイディアの確認からプログラムを作成する。

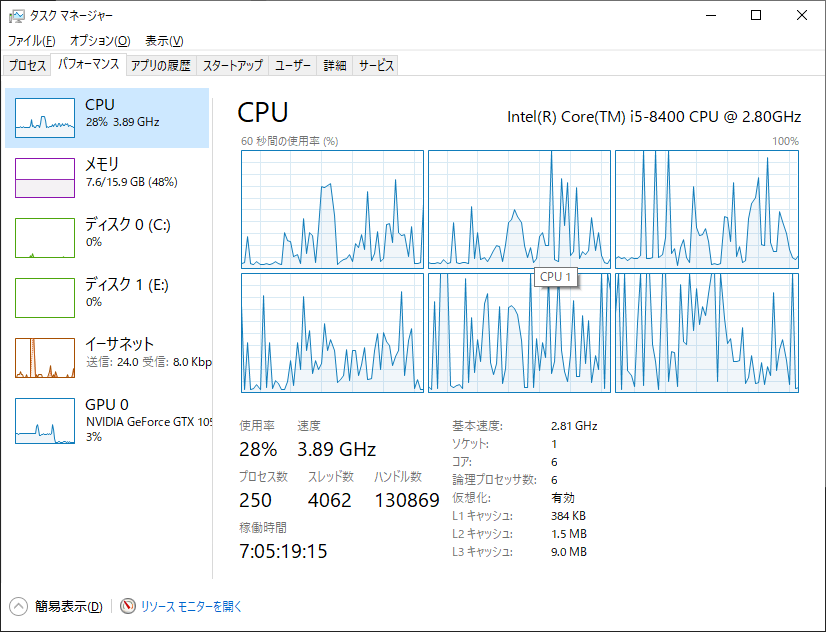

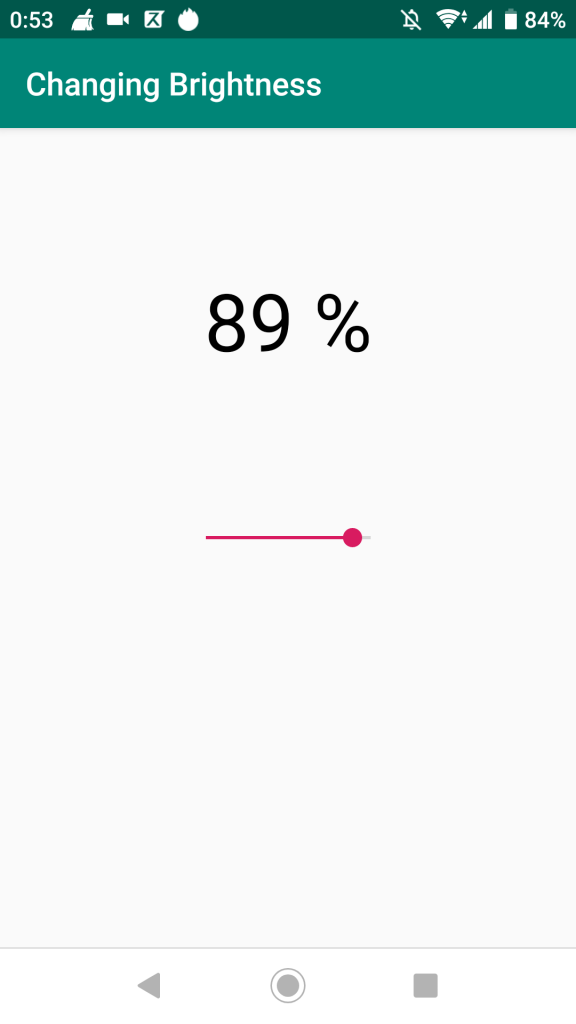

金當:スマホの画面輝度調整アプリの試作に成功したので、画面に縦横、放射状の線を配置するなど、乱視検出に必要な工夫を自ら考案する。

梶岡:顔から多数箇所の輝度値を取得できるプログラムを完成し、これから酒を飲み、実験を協力する人を探す。

庄司:筆跡判定のための学習データに不具合のあるデータが存在していたことに気づき、これから不具合を解消させ、実験を行う。DockerよるGPUマシン運用を提案し、これから運用手法を確立し、運用マニュアルを作成する。来春に向け、本格運用を目指す。

○3週間分の進捗

TDK面談 役員面談にも招待されたので1月にまた面談に行く

冬季インターン申し込み(オリンパス)

Webテストの勉強

研究 プログラムを目と頬を同時に測定するように改正

再現用の動画を撮影

ネット参考に簡単なアプリを作成

○今後の課題

Webテスト受験

研究計画表を作成したのでそれ通りに進めていく

今週の進捗

ES作成(Panasonic)

基礎実験用の器材作成・動画撮影→完了

実験用プログラム作成→実施中

今後の課題

エラーの解決

作成したプログラムの処理速度の高速化

TOEICの勉強

ES作成(Panasonic)

進捗

SeekBarを用いて、(アプリ内での)画面の輝度を変化させるアプリを作成

SeekBar(赤色のバー)を左右に動かすことで輝度を変化させる

課題

インターンシップに向けES作成

androidアプリ開発の勉強

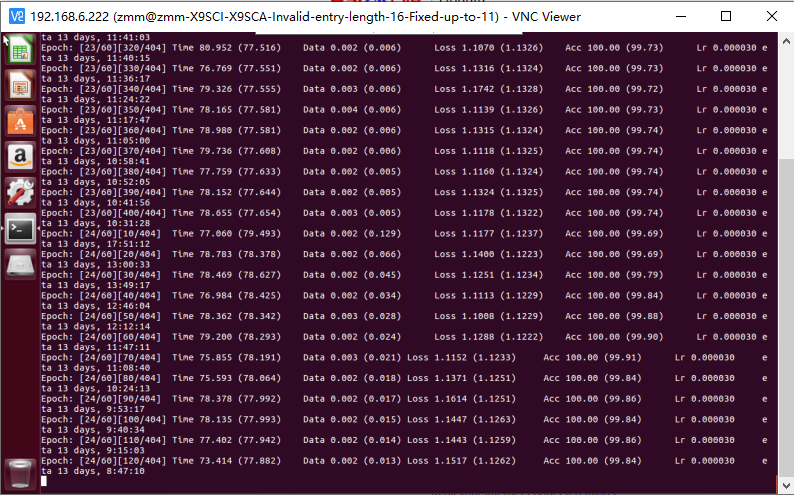

https://github.com/sailordiary/LipNet-PyTorch DL-BOXのCUDAが9になっていたので動かせました。時間がかかりそうだったのでGPUが2枚以上使えないか色々調べたがRNNを含むコードには不向きらしい。。。

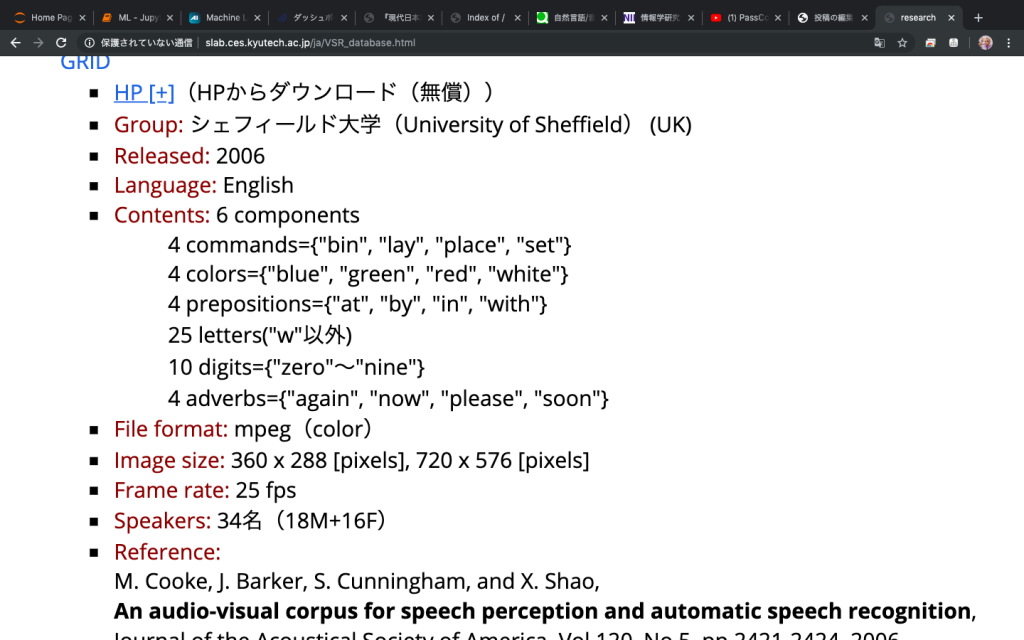

https://github.com/osalinasv/lipnet Kerasで実装されてる方も動いたので精度が良い方を使いたい。どちらもデータセットはGRIDコーパスhttp://spandh.dcs.shef.ac.uk/gridcorpus/ を用いた。

自分で日本語のデータセットを作るためにもう一度LipNetに関する論文に目を通した。https://www.ams.giti.waseda.ac.jp/data/pdf-files/2019_asami_bt.pdf https://arxiv.org/abs/1611.01599

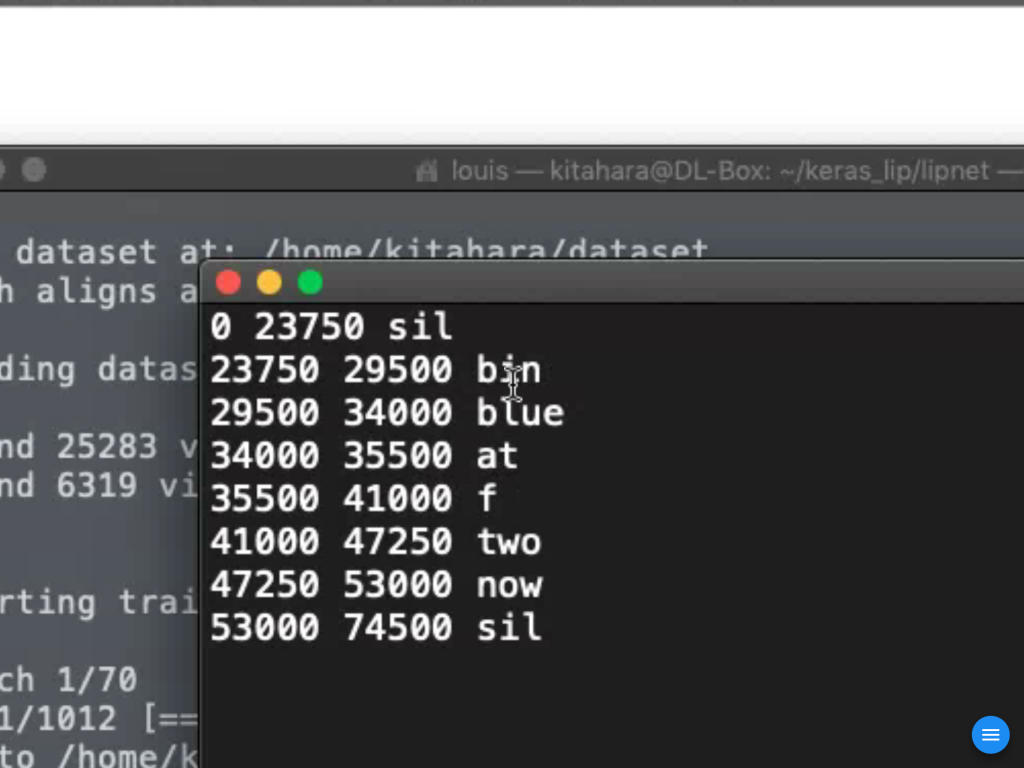

使われてるデータセットのGRIDはcommand + color + preposition + letter + digit + adverb で構成されている。(silは無声期間)

GRIDのアライメントの一つ

各顔パーツのランドマーク座標を取得し、距離を計算することによって顔の向きを上下左右4方向特定することができた。また、検出したむきにあわせてカーソルの移動を行うプログラムを実装した。ただし動きがぎこちなく操作にストレスがかかる状態。

両目を1秒間閉じると音声とともに左クリックするプログラムを実装中。

口の開閉認識もできるため、スクロールを行う際にモード変更ができるように改良する。

12月から被験者を募って実験が開始できるように操作のストレスがなくなる工夫を考えて付け加える。

両目を1秒間閉じるとクリックする関数がうまくいきません

def blink_counter(ear):

while ear < 0.20:Continue Reading ››

出席:全員

中尾:OpenCV とDlibを組み合わせて、顔の向きを検出できた。画像サイズが大きすぎたようで、小さいサイズで試す。

仮屋:GPの参考書を読む、論文を読む。知識を深める。

赤瀬:修論作成中。

藤島: EDGETPUで検出スピードを確認する。

投稿ナビゲーション

Stay Hungry, Stay Foolish!

Continue Reading ››

Continue Reading ››