進捗

- 仮屋さんからAndroid Studio の本を借りて、Javaでアプリ開発の学習を始めた.

課題

- 参考書がKotlinではなくJavaであったため、Javaの学習に切替

- アプリ開発の勉強

DL-Boxにdocker+nvidia-docker2を導入したい。

メリット、コンテナごとにCUDAのバージョンを設定できるので、現状の環境を壊さずに様々なバージョンの機械学習用の環境構築ができる。

tmuxチートシート

https://qiita.com/nmrmsys/items/03f97f5eabec18a3a18b

五十君:レシートの商品名を画像処理で認識し、買い忘れ防止。 研究は二つの部分にわけ、OCR認識の部分と 商品名ー買い物リストのマッチング。OCRの部分はあまり執着をせず。アイディアを重視し、マッチングの部分をよく考える。

北原:DLボックスに実験環境を整えた。サンプルが動かせなかったので。DLボックスの容量を空けることが急務。LipNetの中身を知ること。斎藤先生のプログラムの中身を調べましょう。学習の部分と認識の部分を切り分ける。

白石:学習用データが揃いました。これから学習をさせる。まずはSVMで試す。その後CNNを使ってみる。データ入力の部分は少し難しい部分がある。参考に何かが送る。

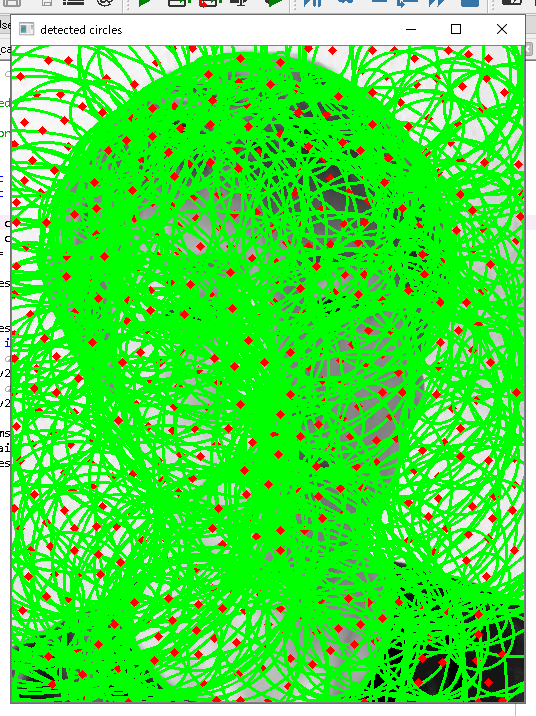

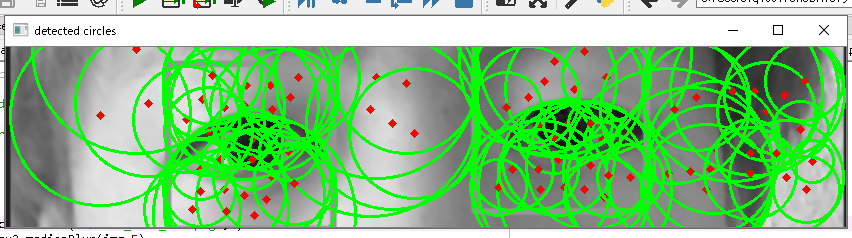

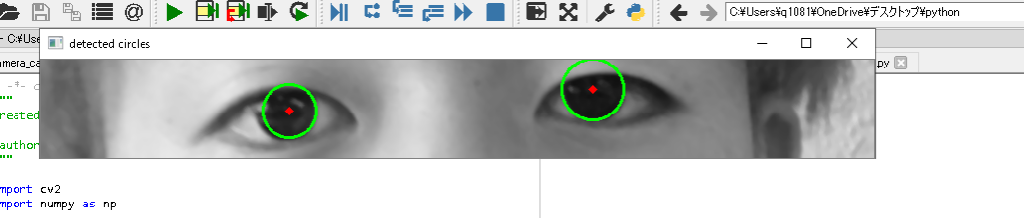

水戸:目線検出でマウス操作を行う。瞳は一応検出ができた。今後はHoughCircles関数の使い方の勉強。目線の検出もためす。

二石:基礎実験済みました。効果良好のようです。今後はコードを作って実験する。

財前:画像処理を利用した目の不自由の方の商品識別。識別したい対象物を特定することも大事ですので、まずそこから突破しましょう。

ディープラーニングについて詳しく学んだ

・誤差逆伝播法について学んだ

・ミニバッチ、勾配降下法について学んだ

標識のパターンの認識のために標識のおおよその特定が必要であると思うので

cascade分類器について調べた。

標識のおおよその特定→標識のパターン読み取り→完全な特定

というシステムが最適と考える。

来週の予定:分類器と複数の画像を用いた標識の認識

webカメラで顔の映像を取得した後、輪郭部分の切り取ることにより顔を動かしたときでも画像において目の位置の座標が一定に保つようになった。

次に取得した顔画像において黒目部分を認識するようにハフ変換を行った。ハフ変換は画像中の円を検出するもので、今回は静止画像で試してみた。顔全体をハフ変換した場合は多数の円が検出されたため、輪郭部分のさらに目の部分を切り取りハフ変換したところうまく黒目部分とその中心がマークされた画像が得られた。

次はwebカメラで取得した顔の映像をハフ変換で黒目をマークするプログラムを作成し、その中心点の座標を表示するプログラムの作成を行う。そのあと、その座標とウィンドウ上のカーソルの位置をリンクさせるプログラムの作成、試行を行う。

患部画像を集めた。

3つとも終わったので、判別できるように取り組む。

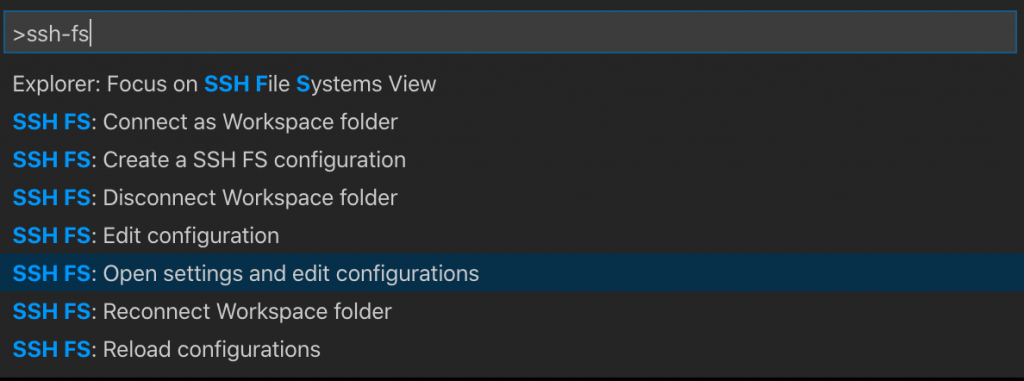

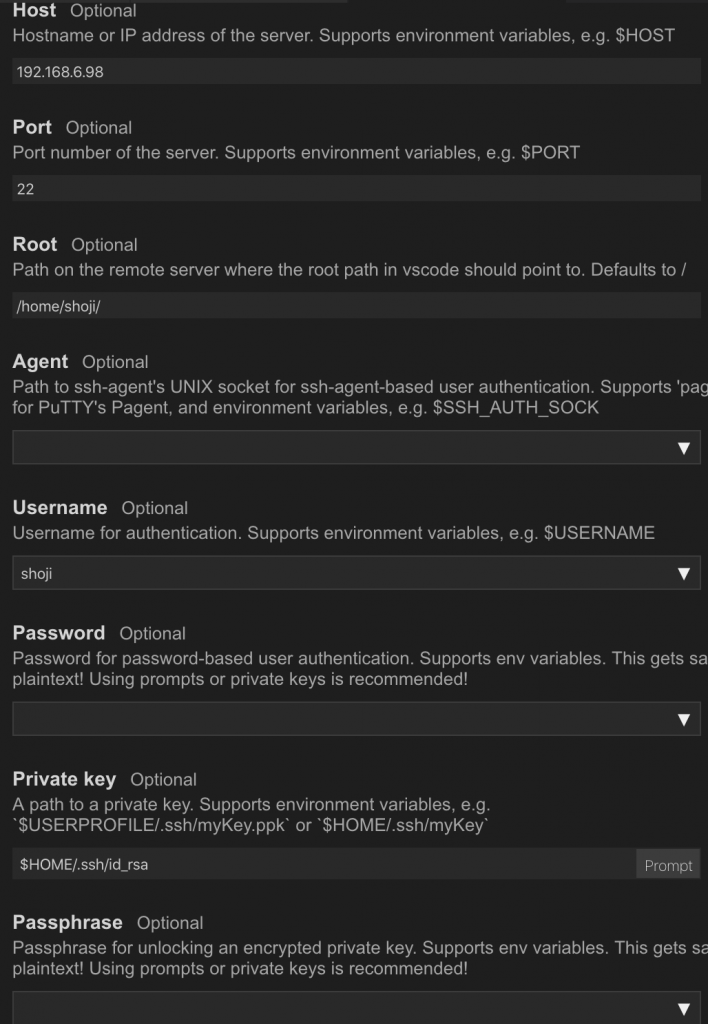

ディープラーニングボックスに接続してPythonの仮想環境を構築してKerasのverを合わせた。

基本情報の試験を受けた。

・来週の目標:dlibを用いて唇の特徴点の抽出を行う

今週の進捗

・レシートの画像に、ノイズ除去や二値化(閾値自動決定型)を施してみて、どれを組み合わせれば一番精度良く文字認識ができるのかを試した。

今後の課題

・商品名の比較方法について考える。