野菜の検知・腕の動きの判定による、入出庫管理のプログラムはおおまかに完成した。野菜の種類を増やす件は、じゃがいも、ピーマン、玉ねぎを学習させている。10種類程度に増やそうと考えていたが、検証のときの野菜の確保が大変そうなのでここら辺でとめようかと。

ラズパイはカメラの動作・磁気センサーの動作を確認した。磁気センサーが起動したらカメラを作動させるプログラムを作成。ラズベリーパイカメラv2がOpen CVのいくつかの機能でサポートされてない可能性があるので、別のカメラも検討している。

ラズベリーパイとLinuxのPC間でのファイル送信でつまづいている。

Linux上で常にフォルダを監視し、フォルダの中に動画ファイルが追加されると入出庫判定を開始するプログラムを作成。

冷蔵庫への実装はまだできていない。野菜の在庫状況を表示、通知する機能は間に合わないかもしれない。

研究の課題である「野菜の入退室判定の精度向上」の部分はデータセットの改善で、古い学習ファイルと比較することで解決できる。

どこまでやればいいですか?

基本情報の勉強をしていてあまり研究は進めてないです。

大ゼミでは以下のような指摘がありました。

・食品ロス解消はいらない?←言うなら解消されることを証明しないといけない。

・野菜5種類は少ないから増やした方がいい

・冷蔵庫に限定されるなら冷蔵庫とタイトルに入れた方がいい。

熱が38度あるため、ゼミを欠席します。安静にしています。

3フレーム毎にx座標の差分をとることで左右反対は可能になった。ただ機械学習をしていることで1フレームごとに12回のイテレーションがあり、処理が非常に長い。正直左右判定にそこまで高い制度は無くても良いと考えているので、機械学習なしのoptical flowも検討している。

内々定懇親会で東京にいるので、ゼミは欠席します。

来週から研究進めてきます

RAFTに、光学フローにおける全体画素の動きを数値化する機能を加えた。結果は1フレームあたりの動きが小さすぎて、毎フレームごとに0.1以下の数値が出力された。これは、何も動きがない状態の誤差と同じ程度の数値だったため改善が必要である。5フレームあたりの動きの差分を取ることで改善しようと考えている。

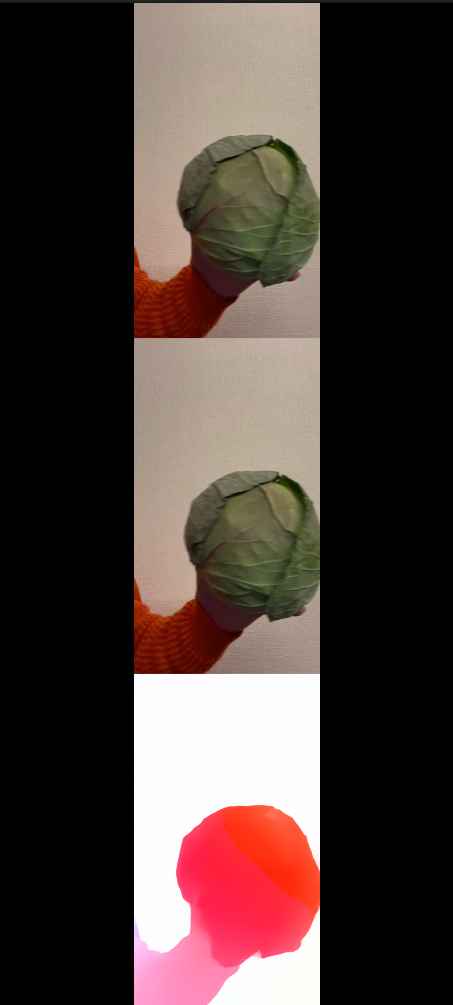

RAFTとAILIA SDKを組み合わせたコードが公開されていたのでそのコードを実行して検証を行った。動画は何故か貼れなかったので画像を貼っておきます。動き自体は追跡できると感じたので、次は光学フローの向きを計算して数値として表示したいと考えている。

Stay Hungry, Stay Foolish!